統一千千Qwen下載量突破4000萬,「催生 」了5萬多個兒童Models。

沒有BS,讓我們先在這裡測試Qwen:。

雲計算 「春晚 」雲栖大會拉開帷幕,砺石奇文大模再次引爆全場!

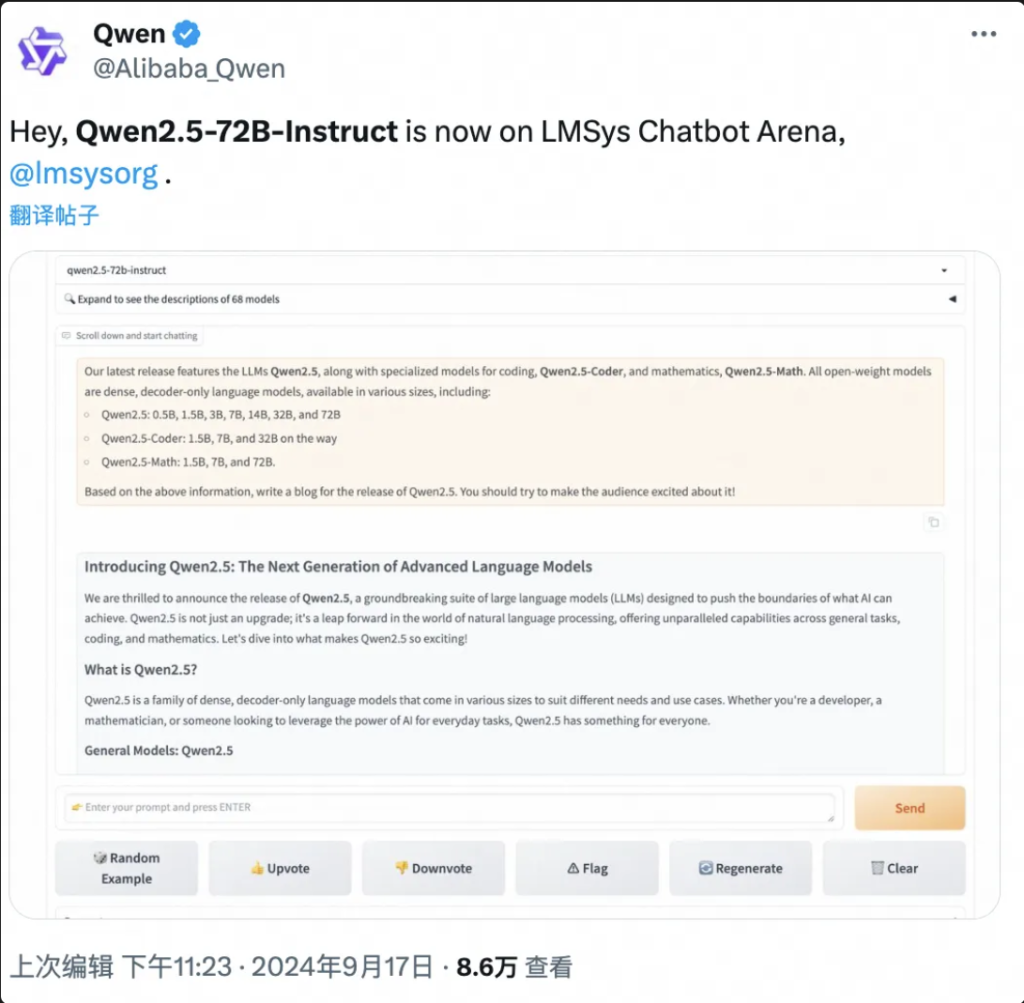

智物聯9月19日杭州報道,今日,阿里雲推出全球強大的開源大模型Qwen2.5-72B,性能 「跨測 」超越Llama3.1-405B,再登全球開源大模型寶座。

n

在許多權威測試中,Qwen2.5-72B 的表現都優於 Llama-405B。

與此同時,一大系列的Qwen2.5模型也隨之開源,包括:語言模型Qwen2.5、視覺語言模型Qwen2-VL-72B、程式模型Qwen2.5-Coder、數學模型Qwen2.5-Math等,累計上架超過100款,其中部分性能更直追GPT-4o,刷新世界紀錄。

「這是瘋狂的星期四」,「史詩級產品」 ...... Qwen2.5在發布後的短短幾個小時內,在國內外的社交媒體上掀起了熱烈的討論,世界各地的開發者也紛紛加入了試玩測試團隊。

▲Qwen2.5是國內外社交媒體上的熱門話題。

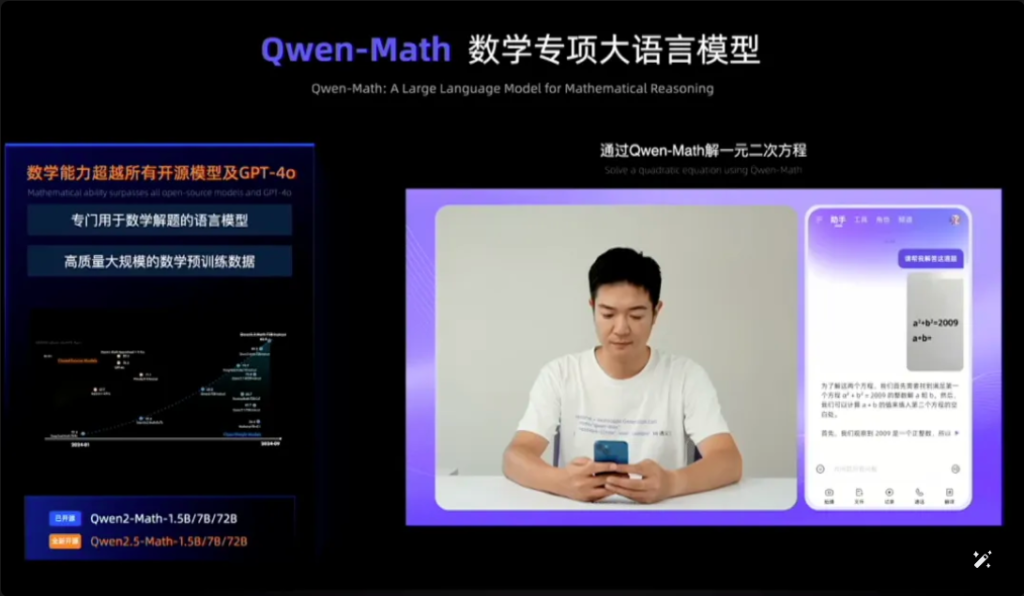

以Qwen2.5-Math為例,Qwen2.5-Math結合了視覺辨識功能。當輸入一張幾何類似選擇題的截圖時,Qwen2.5-Math 能快速識別出該題目意思,並給出正確的解法和答案 "B",既準確又快速。其準確度和速度令人驚嘆。

這是我第一次在網路上看到 Qwen2.5-Math。

▲Qwen2.5-數學試題

自 2023 年 4 月起的短短一年半內,Qwen 已經成長為僅次於 Llama 的世界級模特兒團體。

根據阿里雲CTO周靖人公佈的最新數據,截至2024年9月中旬,通益奇文開源模型累計下載量已超過4000萬次,衍生出5萬多個大型模型。

▲Qwen系列衍生出超過50,000個大型模型

Qwen 2.5 在效能上有哪些具體改進?100款全新開源機型有哪些亮點?Qwen2.5在性能上有哪些具體改進?

部落格地址:https://qwenlm.github.io/blog/qwen2.5/

專案地址:https://huggingface.co/spaces/Qwen/Qwen2.5

▲官方部落格發佈阿里雲Qwen 2.5模型叢集

01.再登全球榜首,Qwen2.5跨卷追上Llama3.1-405B

讓我們具體看看 Qwen2.5 的效能。

Qwen2.5 機型支援最大 128K 上下文長度,可產生最大 8K 內容,並支援超過 29 種語言,也就是說可以幫助使用者撰寫萬字文章。

不僅如此,基於 18T 的代幣資料預先訓練,Qwen2.5 相較於 Qwen2 有超過 18% 的整體效能提升,擁有更多的知識和更強的程式設計和數學能力。

▲阿里雲CTO周靖人解說Qwen2.5

據報導,旗艦機型 Qwen2.5-72B 機型在 MMLU-rudex 基準 (檢測常識)、MBPP 基準 (檢測編碼能力) 和 MATH 基準 (檢測數學能力) 的得分分別高達 86.8、88.2 和 83.1。

擁有 720 億個參數的 Qwen2.5 甚至比擁有 4,050 億個參數的 Llama3.1-405B 「高出幾個數量級」。

Llama3.1-405B 於 2024 年 7 月由 Meta 發表,在超過 150 個基準測試集中,它等於甚至超越當時的 SOTA(業界最佳)機型 GPT-4o,觸發「開源機型就是最强機型」的論調。

Qwen2.5的後續版本Qwen2.5-72B-Instruct在MMLU-redux、MATH、MBPP、LiveCodeBench、Arena-Hard、AlignBench、MT-Bench、MultiPL-E等權威評測中超越了Llama3.1-405B。405B.

圖片

▲Qwen2.5-72B模型評估情況

Qwen2.5 再次成為全球最強大的開放原始碼模式,為「開放原始碼勝過封閉原始碼」的產業趨勢做出貢獻。

這是阿里雲繼今年6月開源的統一千元Qwen2系列後,趕上當時最強的開源機型Llama3-70B,再推出的一系列開源版本。

在 AI 開發者社群中,每當有新的王者出現,很快就會被新版本的統一超越,這已成為大家熟悉的節奏。

9月18日晚上Qwen2.5開放後,很多開發人員興奮得沒有睡覺,先試用了一下。

我不知道我是否能做到這一點。

▲國內外開發者熱議 Qwen2.5

02.史上最大的模特社群

您可以在您的網站上隨時隨地與您的好友分享您的學習經驗,您也可以在您的網站上隨時隨地與您的好友分享您的學習經驗。

Qwen2.5 開放原始碼建模社群是有史以來最大的。

阿里雲CTO周靖人在雲栖大會上宣布,Qwen2.5系列總計上架100多款開源機型,全面適應開發者和中小企業的各種場景需求。

這回應了許多開發人員的呼籲,他們已在各大社群媒體「催促」許久。

▲國內外開發商促進更多 Qwen2.5

1、語言模型:從 0.5B 到 72B 七種尺寸,從終端到工業級場景全覆蓋

Qwen2.5 開放了七種大小的語言模型,包括 0.5B、1.5B、3B、7B、14B、32B 和 72B,這些模型都在相對應的軌道上取得了 SOTA 成績。

圖片

▲多尺寸 Qwen2.5 滿足多樣化的使用場景需求

憑藉其在自然語言處理 (NLP) 和編碼理解方面的先進能力,阿里巴巴雲的 Qwen2.5 旨在處理廣泛的應用。以下是一些可以使用 Qwen2.5 的特定場景:

- 強化客戶服務: Qwen2.5 可應用於聊天機器人,進行更類似於人類的互動,有效地回答客戶的詢問,並提供解決方案。

- 內容創作: 此模型可協助產生文章、社交媒體貼文和其他書面內容,為內容創造者節省時間。

- 程式設計協助: 透過其專門的 Qwen2.5-Coder 系列,它可以透過建議程式碼片段、除錯幫助和自動化某些編碼工作來協助開發人員。

- 教育與學習: Qwen2.5 可用於開發教育工具,例如提供說明、回答學生問題,甚至批改作業的互動學習平台。

- 翻譯服務: 由於精通多國語言,因此可以提供即時翻譯服務,以消除國際溝通中的語言隔閡。

- 研發: 在研究方面,Qwen2.5 可以處理大量的文字資料,以協助發現模式、總結研究結果和產生報告。

- 法律援助: 此模型可閱讀法律文件、擷取相關資訊,甚至草擬基本法律文件,為法律專業人員節省時間。

- 醫療照護支援: Qwen2.5 可用於回答常見的健康問題、提供醫療資訊,以及協助管理病患資料。

- 行銷與廣告: 它可以協助建立針對特定受眾的個人化行銷內容、廣告文案和社群媒體活動。

- 資料分析: Qwen2.5 可處理及分析大型資料集,以提供洞察力並協助做出以資料為導向的決策。

- 自動報告: 此模型可透過處理各領域的資料和資訊來產生報告,特別適用於財務和商業分析。

- 遊戲開發: Qwen2.5 可協助為視訊遊戲角色建立互動式對話和敘述,以提高玩家的參與程度。

- 虛擬助理: 它驅動的虛擬助理可以管理排程、設定提醒事項,並提供個人化的建議。

- 電子商務: Qwen2.5 可協助產生產品說明、處理客戶查詢,以及建立個人化的購物體驗。

- 多語言支援: 它可用於需要多語言互動的全球應用程式,例如國際客戶服務或內容本地化。

這些版本可以幫助開發人員平衡模型能力和成本,適應各種場合。例如,3B 是適應手機等終端設備的黃金尺寸,32B 是開發者最期待的 「性價比之王」,而 72B 則是工業級和科研級情境下的性能之王。

部落格地址:https://qwenlm.github.io/zh/blog/qwen2.5-llm/

2、多模態模型:視覺模型可理解 20 分鐘視訊,語音模型支援 8 種語言

萬眾期待的大型視覺語言模型 Qwen2-VL-72B 今天正式開放原始碼。

Qwen2-VL可辨識不同解析度和長寬比的圖片,可理解20分鐘以上的長視頻,具有調節手機和設備視覺智能的能力,並超越GPT-4o的視覺理解水平。

大型視覺語言模型 Qwen2-VL-72B 開放原始碼

Qwen2-VL-72B 成為全球權威評測 LMSYS Chatbot Arena Leaderboard 得分最高的開源視覺理解模型。

Qwen2-VL-72B 是得分最高的開放原始碼視覺理解模型。

Qwen2-Audio 大型語音語言模型是一個開放原始碼的模型,可以理解人聲、音樂和自然聲音,支援語音聊天、語音訊息分析,支援 8 種以上的語言和方言,在全球主流評測指標中處於領先地位。

部落格地址:http://qwenlm.github.io/blog/qwen2-vl/

3、特殊模型:最先進的開源數學模型登場,直追 GPT-4o

用於編程的 Qwen2.5-Coder 和用於數學的 Qwen2.5-Math 也在這次的 Cloud Habitat Conference 中宣佈開放原始碼。

其中,Qwen2.5-Math 是迄今為止最先進的開源數學模型系列,這次開源了 1.5B、7B、72B 三種大小和數學獎勵模型 Qwen2.5-Math-RM。

▲Qwen2.5-Math 開放原始碼

旗艦機型 Qwen2-Math-72B-Instruct 在數學相關的下游任務上,表現優於 GPT-4o 和 Claude 3.5 等專屬機型。

Qwen2.5-Coder在多達5.5T代幣的程式相關資料上進行了訓練,並於同一天開放了1.5B和7B版本的原始碼,未來還將開放32B版本的原始碼。

▲Qwen2.5-Coder 開放原始碼

部落格地址:

https://qwenlm.github.io/zh/blog/qwen2.5-math/

https://qwenlm.github.io/zh/blog/qwen2.5-coder/

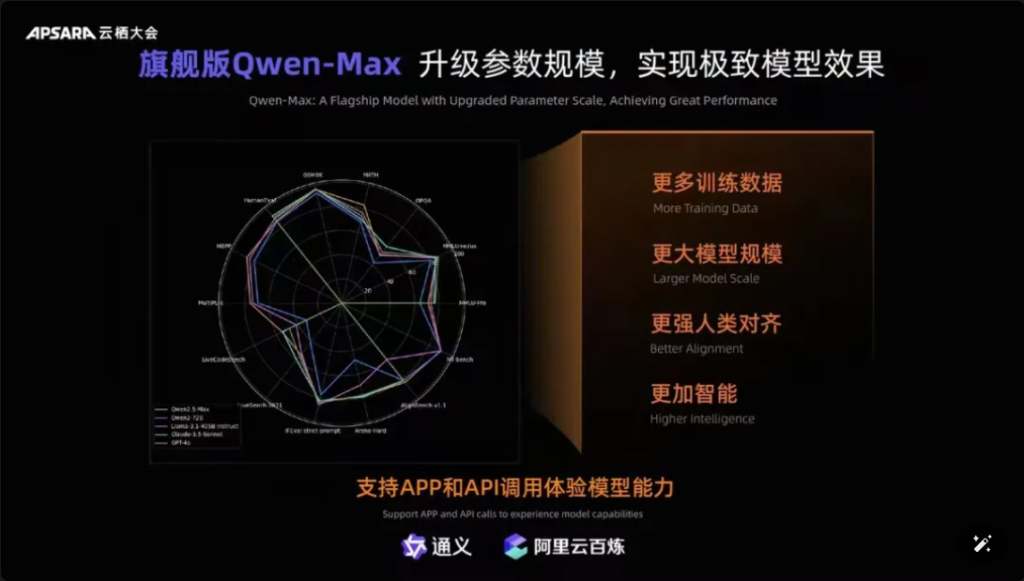

此外,值得一提的是,同益前置旗舰机型Qwen-Max已全面升级,在MMLU-Pro、MATH等十余项权威基准测试上接近甚至超越GPT-4o,并在同益前置官网和同益APP上线。用戶還可以通過阿里雲百煉平台調用Qwen-Max的API。

圖片

▲Qwen-Max實現全面升級

自 2023 年 4 月發布第一代統一千元大機型以來,阿里雲讓中國企業以低成本使用大機型,進而推動今天的 Qwen2.5 系列「越用越好」。

Qwen2.5系列模型涵蓋了基本版、指令跟隨版、量化版,並在實際應用場景中不斷迭代。

03.Qwen下載量突破4000萬!5萬多個 「寶寶 」誕生。

經過一年半的快速發展,同益群文已成為僅次於喇嘛的世界級模範集團。

周敬仁公布的兩組最新數據印證了這一點:

首先是模型下載量,截至2024年9月初,通益錢文的開源模型累計下載量已超過4000萬次,這是開發者和中小企業用腳投票的結果;

其次是衍生模型的數量,截至 9 月初,通益的原生模型和衍生模型總數超過 5 萬個,僅次於 Llama。

▲同易千題開源模型累計下載量突破4000萬次

至此,「萬款同源 」已成為中國大模型產業發展的重要趨勢。

概念是什麼?中國的開源不僅在性能上位居世界第一,在生態拓展上也是世界第一。開源社區、生態夥伴、海內外開發者成為通益千秋的 「自來水」,成為眾多企業最先採用的大模式,也是使用時間最長的大模式。

早在2023年8月,阿里雲就將通益Qwen的70億參數模型開源免費商業化,隨後今年的Qwen1.5、Qwen2、Qwen2.5相繼發布,讓開發者在快速使用最先進模型的同時,獲得更大的控制權和調校空間,從而成為更多企業的首選。

7 月初,全球最大的開源社區抱抱臉的工程師曾發微博認證,同益是中國滾動最多的大模型。而通过阿里云,同益大模型已经服务了超过30万的各行业客户。在刚刚过去的2024年第二季度(对应阿里巴巴2025财年第一季度),阿里云人工智能相关产品收入实现了三位数增长。

▲同益大模型服務超過 30 萬名客戶

阿里雲做對了什麼?

在我看来,不同于国外大厂微软与ChatGPT强绑定、亚马逊AWS融合的三方模式做底层基础架构,阿里云整合了两者的优势,一开始就选择了AI基础服务和自研两手抓的大模式。

專注於自研模型的阿里雲,是國內唯一一家堅定認清模型開源與開放的雲巨頭,在模型突破、生態兼容、開發者服務等方面不遺餘力地進行巨額投入,讓通益大模型一步步邁入世界人工智能競爭的核心圈。

04.結論所有模型都有相同的起源 產業分水嶺時刻

開放原始碼機型正在追上甚至趕上封閉原始碼機型。從7月份Meta的Llama-405B到今天阿里雲的Qwen2.5-72B,「所有模型同源 」的格局正在形成。同源钱柜娱乐大模型一年半的突飞猛进,让很多行业和企业实现了更低成本的AI规模落地,行业正在进入一个新的分水岭。

常見問題

- 問:Qwen2.5 有哪些不同的機型尺寸? 答:Qwen2.5 提供一系列從 0.5B 到 72B 參數的機型,提供各種應用和需求的選擇。

- 問:Qwen2.5 如何支援編程工作? 答:Qwen2.5 包含稱為 Qwen2.5-Coder 的專門系列,旨在增強代碼生成、推理和除錯功能,最多可支援 128K tokens。

- 問:Qwen2.5 的訓練資料是怎樣的? 答:Qwen2.5 已在涵蓋多達 18 兆個字詞的龐大資料集上進行預先訓練,可確保對語言的廣泛理解。

- 問:Qwen2.5 是否適合在教育界使用? 答:是的,Qwen2.5 在自然語言處理方面的能力使其適用於教育工具,包括互動學習平台。

- 問:與其他機型相比,Qwen2.5 在基準測試中的表現如何? 答:Qwen2.5 目前在多模式基準中排名第三,在多個領域都優於 Llama3.1 等模型。

- 問:Qwen2.5 支援哪些語言? 答:Qwen2.5 支援多種語言,包括但不限於 Python、Java 和 C++。

- 問:Qwen2.5 可以產生多種程式語言的程式碼嗎? 答:是的,Qwen2.5-Coder 能夠生成各種程式語言的代碼,滿足不同開發人員的需求。

- 問:Qwen2.5 如何處理長上下文? 答:Qwen2.5 支援最大 32K 的上下文長度,這有利於提高程式碼完成和推論的準確性。

- 問:Qwen2.5 是否開放原始碼? 答:雖然 Qwen2.5 的開放原始碼版本尚未推出,但在 GitHub 等平台上有詳細的說明文件和範例。

- 問:Qwen2.5 有哪些實際應用情境? 答:Qwen2.5 可應用於客服聊天機器人、內容創作、程式輔助、教育、翻譯服務、法律協助、醫療保健支援、行銷、資料分析、自動化報表、遊戲開發、虛擬助理、電子商務,以及跨產業的多語言支援。