ยอดดาวน์โหลด Tongyi Qianqian Qwen เกิน 40 ล้านครั้ง “สร้าง” นางแบบเด็กมากกว่า 50,000 ราย

ไม่มี BS ให้ทดสอบ Qwen ที่นี่ก่อน:

งานประชุม Yunqi ด้านคลาวด์คอมพิวติ้ง “Spring Festival Gala” เปิดแล้ว นางแบบสาวใหญ่ Tongyi Qwen ระเบิดความเคลื่อนไหวอีกครั้ง!

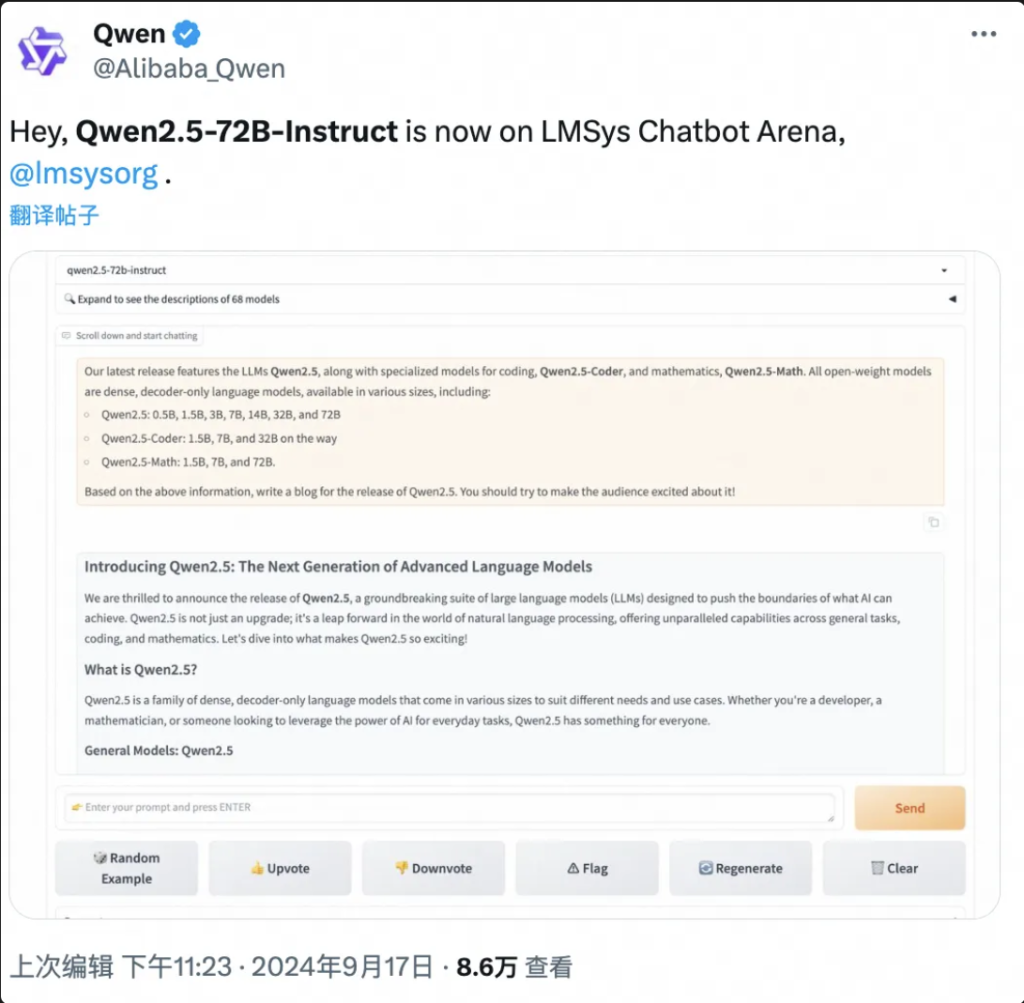

Wise Things รายงานเมื่อวันที่ 19 กันยายน ในเมืองหางโจว วันนี้ Ali Cloud เปิดตัวโมเดลโอเพ่นซอร์สขนาดใหญ่ที่แข็งแกร่งที่สุดในโลก Qwen2.5-72B ประสิทธิภาพ "แบบไขว้" เหนือกว่า Llama3.1-405B และจากนั้นก็ขึ้นครองบัลลังก์โมเดลโอเพ่นซอร์สขนาดใหญ่ระดับโลก

ต่อไปนี้เป็นสรุปผลงานของโครงการนี้

Qwen2.5-72B มีประสิทธิภาพเหนือกว่า Llama-405B ในการทดสอบที่เชื่อถือได้หลายครั้ง

ในเวลาเดียวกัน ซีรีส์ใหญ่ของโมเดล Qwen2.5 ก็ได้รับการโอเพนซอร์ส ซึ่งรวมถึงโมเดลภาษา Qwen2.5, โมเดลภาษาภาพ Qwen2-VL-72B, โมเดลการเขียนโปรแกรม Qwen2.5-Coder และโมเดลคณิตศาสตร์ Qwen2.5-Math เป็นต้น โดยมียอดรวมทั้งหมดมากกว่า 100 โมเดล และบางโมเดลยังได้ไล่ตามประสิทธิภาพของ GPT-4o และสร้างสถิติโลกใหม่

“วันพฤหัสฯ ที่แสนบ้าระห่ำ” 'ผลิตภัณฑ์สุดยิ่งใหญ่' …… ในเวลาเพียงไม่กี่ชั่วโมงหลังจากเปิดตัว Qwen2.5 ได้จุดชนวนให้เกิดการพูดคุยอย่างคึกคักบนโซเชียลมีเดียทั้งในประเทศและต่างประเทศ และนักพัฒนาจากทั่วโลกก็ได้เข้าร่วมทีมทดสอบทดลองแล้ว

▲Qwen2.5 เป็นหัวข้อร้อนแรงในโซเชียลมีเดียทั้งในและต่างประเทศ

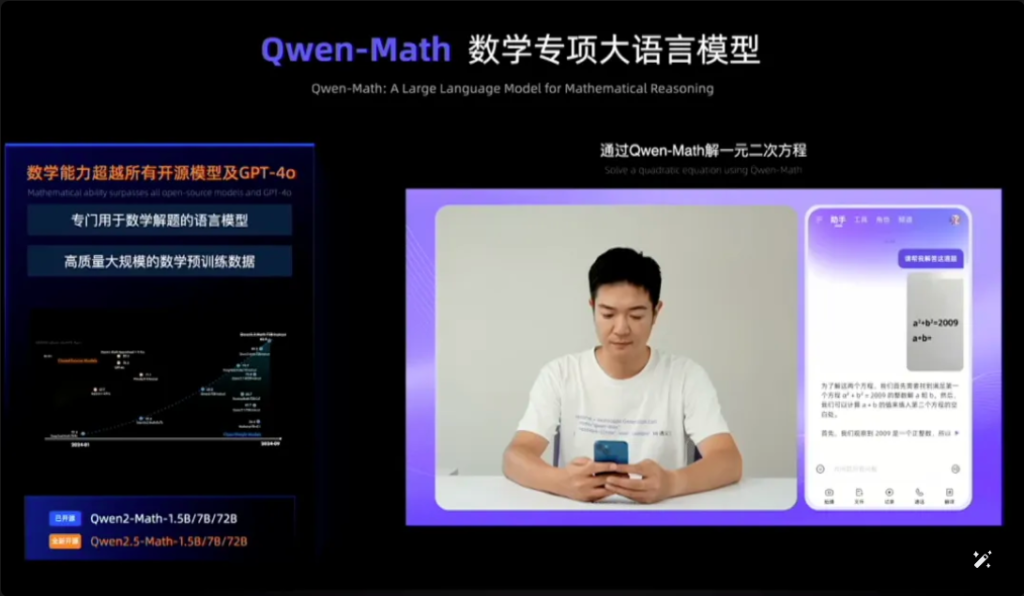

ตัวอย่างเช่น Qwen2.5-Math จะรวมการจดจำภาพเข้ากับ Qwen2.5-Math เมื่อป้อนภาพหน้าจอของคำถามแบบเลือกตอบที่มีรูปทรงเรขาคณิตคล้ายกัน Qwen2.5-Math จะจดจำความหมายของคำถามได้อย่างรวดเร็ว และให้คำตอบที่ถูกต้องและ "B" ซึ่งทั้งแม่นยำและรวดเร็ว ความแม่นยำและความเร็วนั้นน่าทึ่งมาก

นี่เป็นครั้งแรกที่ฉันเห็น Qwen2.5-Math บนเว็บ

▲Qwen2.5-ทดลองคณิตศาสตร์

ในเวลาเพียงหนึ่งปีครึ่งนับตั้งแต่เดือนเมษายน พ.ศ. 2566 Qwen ได้เติบโตกลายเป็นกลุ่มนางแบบระดับโลกเป็นรองเพียง Llama เท่านั้น

ตามข้อมูลล่าสุดที่เผยแพร่โดย Zhou Jingren ซึ่งเป็น CTO ของ AliCloud เมื่อกลางเดือนกันยายน 2024 จำนวนการดาวน์โหลดสะสมของโมเดลโอเพนซอร์สของ Tongyi Qwen ทะลุ 40 ล้านครั้งแล้ว และได้โมเดลขนาดใหญ่แล้วมากกว่า 50,000 โมเดล

▲ซีรีส์ Qwen สืบทอดโมเดลขนาดใหญ่กว่า 50,000 ชิ้น

Qwen 2.5 มีการปรับปรุงประสิทธิภาพเฉพาะอะไรบ้าง? จุดเด่นของโมเดลโอเพนซอร์สใหม่ 100 โมเดลคืออะไร? Qwen2.5 เป็นรุ่นแรกของโลกและรุ่นแรกในจีน

ที่อยู่บล็อก: https://qwenlm.github.io/blog/qwen2.5/

ที่อยู่โครงการ: https://huggingface.co/spaces/Qwen/Qwen2.5

▲บล็อกอย่างเป็นทางการเปิดตัวโมเดลคลัสเตอร์ Aliyun Qwen 2.5

01.ขึ้นสู่อันดับหนึ่งของรายการระดับโลกอีกครั้ง Qwen2.5 ข้ามเล่ม ตามทัน Llama3.1-405B

มาดูประสิทธิภาพของ Qwen2.5 กันโดยเฉพาะ

โมเดล Qwen2.5 รองรับความยาวบริบทสูงสุด 128K สร้างเนื้อหาได้สูงสุดถึง 8K และรองรับมากกว่า 29 ภาษา ซึ่งหมายความว่าสามารถช่วยผู้ใช้เขียนบทความได้ 10,000 คำ

ไม่เพียงเท่านั้น จากการฝึกอบรมล่วงหน้าข้อมูลโทเค็น 18T Qwen2.5 ยังมีการปรับปรุงประสิทธิภาพโดยรวมมากกว่า 18% เมื่อเทียบกับ Qwen2 โดยมีความรู้ที่มากขึ้นและทักษะการเขียนโปรแกรมและคณิตศาสตร์ที่แข็งแกร่งขึ้น

▲AliCloud CTO Zhou Jingren อธิบาย Qwen2.5

มีรายงานว่ารุ่นเรือธง Qwen2.5-72B ทำคะแนนได้สูงถึง 86.8, 88.2 และ 83.1 ในเกณฑ์มาตรฐาน MMLU-rudex (ซึ่งตรวจสอบความรู้ทั่วไป) เกณฑ์มาตรฐาน MBPP (ซึ่งตรวจสอบความสามารถในการเขียนโค้ด) และเกณฑ์มาตรฐาน MATH (ซึ่งตรวจสอบความสามารถทางคณิตศาสตร์)

Qwen2.5 ที่มีพารามิเตอร์ 72 พันล้านตัว ยังทำผลงานได้ดีกว่า Llama3.1-405B ที่มีพารามิเตอร์ 405 พันล้านตัว "ด้วยลำดับความสำคัญ"

Llama3.1-405B เปิดตัวโดย Meta ในเดือนกรกฎาคม 2024 และในชุดการทดสอบประสิทธิภาพมากกว่า 150 ชุด Llama3.1-405B เทียบเท่าหรือแม้กระทั่งแซงหน้าโมเดล GPT-4o ซึ่งเป็นโมเดล SOTA (ดีที่สุดในอุตสาหกรรม) ในขณะนั้น จนทำให้เกิดข้อกล่าวอ้างที่ว่า "โมเดลโอเพนซอร์สที่แข็งแกร่งที่สุดคือโมเดลที่แข็งแกร่งที่สุด"

Qwen2.5-72B-Instruct ซึ่งเป็นเวอร์ชันต่อจาก Qwen2.5 แซงหน้า Llama3.1-405B ในการประเมิน MMLU-redux, MATH, MBPP, LiveCodeBench, Arena-Hard, AlignBench, MT-Bench, MultiPL-E และการประเมินที่น่าเชื่อถืออื่นๆ

รูปภาพ

▲สถานการณ์การประเมินโมเดล Qwen2.5-72B

Qwen2.5 ถือเป็นโมเดลโอเพ่นซอร์สที่แข็งแกร่งที่สุดในโลกอีกครั้ง ส่งผลให้เกิดกระแสนิยมของอุตสาหกรรมที่ว่า “โอเพ่นซอร์สเหนือกว่าซอร์สปิด”

นี่คือ AliCloud ที่ติดตามซีรีส์โอเพ่นซอร์ส Tongyi Qianqian Qwen2 ในเดือนมิถุนายนของปีนี้ จากนั้นจึงไล่ตามโมเดลโอเพ่นซอร์สที่แข็งแกร่งที่สุดในขณะนั้นอย่าง Llama3-70B จากนั้นจึงเปิดตัวซีรีส์เวอร์ชันโอเพ่นซอร์สอีกชุด

มันได้กลายเป็นจังหวะที่คุ้นเคยในชุมชนนักพัฒนา AI แล้วว่าราชาองค์ใหม่ทุกองค์ที่ปรากฏตัวในไม่ช้าก็จะถูกแซงหน้าโดย Tongyi เวอร์ชันใหม่

หลังจากที่ Qwen2.5 เปิดตัวในช่วงเย็นของวันที่ 18 กันยายน นักพัฒนามากมายก็ตื่นเต้นมากจนแทบไม่อยากนอน และได้ลองเล่นเป็นครั้งแรก

ฉันไม่แน่ใจว่าฉันจะสามารถทำแบบนั้นได้ไหม

▲นักพัฒนาทั้งในและต่างประเทศหารือกันอย่างร้อนแรงเกี่ยวกับ Qwen2.5

02.ชุมชนนางแบบที่ใหญ่ที่สุดในประวัติศาสตร์โลก

สิ่งที่สำคัญที่สุดคือการมีความเข้าใจที่ดีเกี่ยวกับสิ่งที่เกิดขึ้นในโลกและมันทำงานอย่างไร

ชุมชนการสร้างแบบจำลองโอเพนซอร์ส Qwen2.5 ถือเป็นชุมชนที่ใหญ่ที่สุดที่เคยมีมา

โจว จิงเหริน CTO ของ AliCloud ประกาศที่การประชุม Yunqi ว่าซีรีส์ Qwen2.5 มีโมเดลโอเพนซอร์สรวมกว่า 100 โมเดลบนชั้นวาง ซึ่งปรับให้เหมาะกับความต้องการของนักพัฒนาและ SME ในสถานการณ์ต่างๆ ได้อย่างเต็มที่

นี่เป็นการตอบรับเสียงเรียกร้องของนักพัฒนามากมายที่ "เรียกร้อง" กันมายาวนานในโซเชียลมีเดียหลัก

▲นักพัฒนาทั้งในและต่างประเทศเรียกร้องให้มี Qwen2.5 มากขึ้น

1. โมเดลภาษา: ตั้งแต่ 0.5B ถึง 72B เจ็ดขนาด ตั้งแต่ด้านปลายจนถึงระดับอุตสาหกรรม ครอบคลุมเต็มรูปแบบ

Qwen2.5 โอเพนซอร์สโมเดลภาษาขนาดเจ็ดแบบ ได้แก่ 0.5B, 1.5B, 3B, 7B, 14B, 32B และ 72B ซึ่งทั้งหมดได้ผลลัพธ์ SOTA ในแทร็กที่สอดคล้องกัน

รูปภาพ

▲Qwen2.5 หลายขนาดตอบสนองความต้องการของสถานการณ์ที่หลากหลาย

Qwen2.5 ของ Alibaba Cloud ได้รับการออกแบบมาให้รองรับแอพพลิเคชั่นต่างๆ ได้หลากหลาย โดยมีความสามารถขั้นสูงในการประมวลผลภาษาธรรมชาติ (NLP) และการทำความเข้าใจการเข้ารหัส ต่อไปนี้คือสถานการณ์เฉพาะบางส่วนที่สามารถใช้ Qwen2.5 ได้:

- การบริการลูกค้าที่ได้รับการปรับปรุง: Qwen2.5 สามารถนำมาใช้ในแชทบอทเพื่อการโต้ตอบที่ใกล้เคียงกับมนุษย์มากขึ้น ตอบคำถามของลูกค้าได้อย่างมีประสิทธิภาพและมอบโซลูชั่น

- การสร้างเนื้อหา: โมเดลดังกล่าวสามารถช่วยในการสร้างบทความ โพสต์บนโซเชียลมีเดีย และเนื้อหาที่เขียนอื่นๆ ซึ่งจะช่วยประหยัดเวลาของผู้สร้างเนื้อหา

- ความช่วยเหลือด้านการเขียนโปรแกรม: ด้วยซีรีย์ Qwen2.5-Coder ที่เป็นนวัตกรรมเฉพาะ มันสามารถช่วยเหลือนักพัฒนาได้โดยการแนะนำชิ้นส่วนโค้ด ช่วยเหลือในการดีบัก และทำงานโค้ดอัตโนมัติบางส่วน

- การศึกษาและการเรียนรู้: Qwen2.5 สามารถนำมาใช้เพื่อพัฒนาเครื่องมือทางการศึกษา เช่น แพลตฟอร์มการเรียนรู้แบบโต้ตอบที่ให้คำอธิบาย ตอบคำถามของนักเรียน และแม้แต่การให้คะแนน

- บริการแปลเอกสาร : ด้วยความสามารถในการใช้หลายภาษา ทำให้สามารถให้บริการแปลแบบเรียลไทม์เพื่อลดช่องว่างทางภาษาในการสื่อสารระหว่างประเทศได้

- การวิจัยและพัฒนา: ในการวิจัย Qwen2.5 สามารถประมวลผลข้อมูลข้อความจำนวนมากเพื่อช่วยค้นพบรูปแบบ สรุปผลการค้นพบ และจัดทำรายงาน

- ความช่วยเหลือทางกฎหมาย: โมเดลนี้สามารถอ่านเอกสารทางกฎหมาย ดึงข้อมูลที่เกี่ยวข้อง และแม้แต่ร่างเอกสารทางกฎหมายพื้นฐาน ช่วยประหยัดเวลาให้กับผู้เชี่ยวชาญทางกฎหมาย

- การสนับสนุนด้านการดูแลสุขภาพ: Qwen2.5 สามารถใช้เพื่อตอบคำถามสุขภาพทั่วไป ให้ข้อมูลทางการแพทย์ และช่วยจัดการข้อมูลผู้ป่วย

- การตลาดและการโฆษณา: สามารถช่วยสร้างเนื้อหาการตลาด ข้อความโฆษณา และแคมเปญบนโซเชียลมีเดียที่ตรงกับกลุ่มเป้าหมายได้โดยเฉพาะ

- การวิเคราะห์ข้อมูล: Qwen2.5 สามารถประมวลผลและวิเคราะห์ชุดข้อมูลขนาดใหญ่เพื่อให้ข้อมูลเชิงลึกและช่วยในการตัดสินใจโดยอิงตามข้อมูล

- การรายงานอัตโนมัติ: โมเดลนี้สามารถสร้างรายงานได้โดยการประมวลผลข้อมูลและข้อมูลในด้านต่างๆ ซึ่งมีประโยชน์อย่างยิ่งในการวิเคราะห์ทางการเงินและธุรกิจ

- การพัฒนาเกม: Qwen2.5 ช่วยสร้างบทสนทนาแบบโต้ตอบและเรื่องเล่าสำหรับตัวละครในวิดีโอเกมเพื่อเพิ่มการมีส่วนร่วมของผู้เล่น

- ผู้ช่วยเสมือน: ขับเคลื่อนผู้ช่วยเสมือนที่สามารถจัดการตารางเวลา ตั้งการแจ้งเตือน และให้คำแนะนำแบบส่วนตัว

- อีคอมเมิร์ซ: Qwen2.5 ช่วยสร้างคำอธิบายผลิตภัณฑ์ จัดการการสอบถามของลูกค้า และสร้างประสบการณ์การช้อปปิ้งแบบเฉพาะบุคคล

- รองรับหลายภาษา: สามารถนำไปใช้กับแอปพลิเคชันระดับโลกที่ต้องการการโต้ตอบหลายภาษา เช่น บริการลูกค้าระหว่างประเทศ หรือการแปลเนื้อหา

เวอร์ชันเหล่านี้ช่วยให้นักพัฒนาสามารถจัดสมดุลระหว่างความสามารถและต้นทุนของโมเดล และปรับให้เข้ากับสถานการณ์ต่างๆ ได้ ตัวอย่างเช่น 3B ถือเป็นขนาดทองในการปรับให้เข้ากับโทรศัพท์มือถือและอุปกรณ์ปลายทางอื่นๆ 32B ถือเป็น "ราชาแห่งความคุ้มทุน" ที่นักพัฒนาคาดหวังมากที่สุด และ 72B ถือเป็นราชาแห่งประสิทธิภาพของสถานการณ์ระดับอุตสาหกรรมและระดับการวิจัยทางวิทยาศาสตร์

ที่อยู่บล็อก: https://qwenlm.github.io/zh/blog/qwen2.5-llm/

2、โมเดลหลายโหมด: โมเดลภาพเข้าใจวิดีโอ 20 นาที โมเดลเสียง-ภาษารองรับ 8 ภาษา

Qwen2-VL-72B ซึ่งเป็นโมเดลภาษาภาพขนาดใหญ่ที่ได้รับการรอคอยอย่างมาก ได้รับการเผยแพร่อย่างเป็นทางการแล้วในวันนี้

Qwen2-VL สามารถจดจำภาพที่มีความละเอียดและอัตราส่วนภาพที่แตกต่างกันได้ เข้าใจวิดีโอที่ยาวกว่า 20 นาที สามารถควบคุมสติปัญญาในการมองเห็นของโทรศัพท์มือถือและอุปกรณ์ต่างๆ ได้ และมีความเข้าใจภาพในระดับสูงกว่า GPT-4o

▲โมเดลภาษาภาพขนาดใหญ่ Qwen2-VL-72B โอเพ่นซอร์ส

Qwen2-VL-72B กลายเป็นโมเดลความเข้าใจภาพโอเพ่นซอร์สที่มีคะแนนสูงสุดในการประเมิน LMSYS Chatbot Arena Leaderboard ที่น่าเชื่อถือระดับโลก

Qwen2-VL-72B เป็นโมเดลความเข้าใจภาพโอเพ่นซอร์สที่มีคะแนนสูงสุด

แบบจำลองภาษาเสียงขนาดใหญ่ Qwen2-Audio เป็นแบบจำลองโอเพ่นซอร์สที่สามารถเข้าใจเสียงของมนุษย์ ดนตรี และเสียงธรรมชาติ รองรับการแชทด้วยเสียง การวิเคราะห์ข้อความเสียง และรองรับมากกว่า 8 ภาษาและสำเนียงถิ่น และเป็นผู้นำระดับโลกในดัชนีการประเมินกระแสหลัก

ที่อยู่บล็อก: http://qwenlm.github.io/blog/qwen2-vl/

3. โมเดลพิเศษ: เปิดตัวโมเดลคณิตศาสตร์โอเพ่นซอร์สที่ล้ำหน้าที่สุด ไล่ตาม GPT-4o ทัน

นอกจากนี้ Qwen2.5-Coder สำหรับการเขียนโปรแกรมและ Qwen2.5-Math สำหรับคณิตศาสตร์ ยังได้รับการประกาศให้เป็นโอเพ่นซอร์สที่งาน Cloud Habitat Conference อีกด้วย

ในบรรดานั้น Qwen2.5-Math ถือเป็นซีรีย์โมเดลคณิตศาสตร์โอเพ่นซอร์สที่ก้าวหน้าที่สุดจนถึงปัจจุบัน โดยคราวนี้เป็นโอเพ่นซอร์ส 1.5B, 7B, 72B สามขนาดและโมเดลรางวัลคณิตศาสตร์ Qwen2.5-Math-RM

▲Qwen2.5-โอเพ่นซอร์สคณิตศาสตร์

โมเดลเรือธง Qwen2-Math-72B-Instruct มีประสิทธิภาพเหนือกว่าโมเดลที่เป็นกรรมสิทธิ์เช่น GPT-4o และ Claude 3.5 ในงานดาวน์สตรีมที่เกี่ยวข้องกับคณิตศาสตร์

Qwen2.5-Coder ซึ่งได้รับการฝึกฝนด้วยโทเค็นข้อมูลที่เกี่ยวข้องกับการเขียนโปรแกรมสูงสุดถึง 5.5T ได้มีการเปิดตัวเป็นโอเพ่นซอร์สในวันเดียวกันในเวอร์ชัน 1.5B และ 7B และจะเปิดตัวเป็นโอเพ่นซอร์สในอนาคตในเวอร์ชัน 32B

▲Qwen2.5-Coder โอเพ่นซอร์ส

ที่อยู่บล็อก:

https://qwenlm.github.io/zh/blog/qwen2.5-math/

https://qwenlm.github.io/zh/blog/qwen2.5-coder/

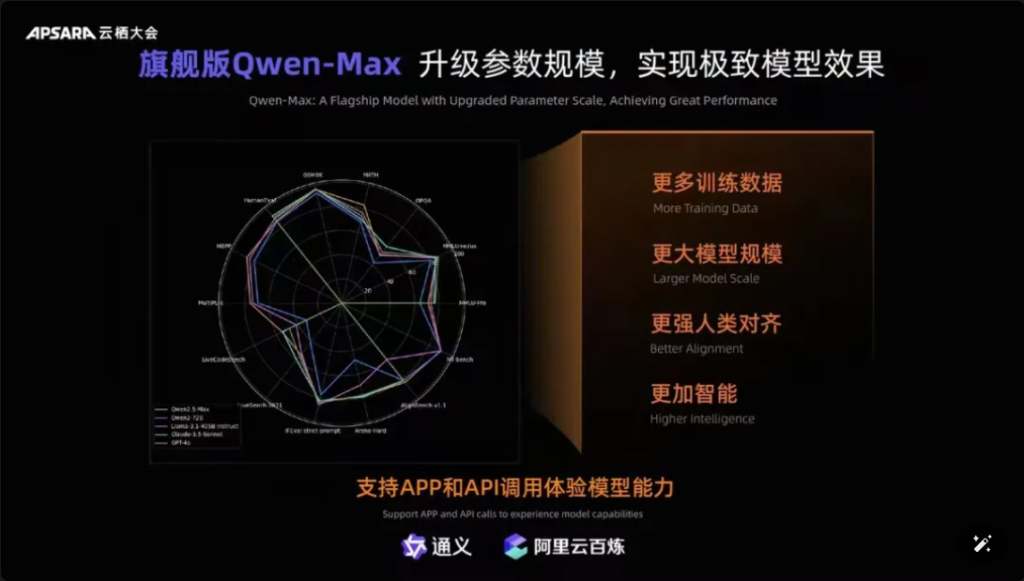

นอกจากนี้ ยังควรกล่าวถึงว่า Qwen-Max ซึ่งเป็นรุ่นเรือธงของ Tongyiqianqian ได้รับการอัพเกรดอย่างเต็มที่ เข้าใกล้หรืออาจแซงหน้า GPT-4o ในเกณฑ์มาตรฐานที่น่าเชื่อถือมากกว่าสิบรายการ เช่น MMLU-Pro, MATH เป็นต้น และออนไลน์อยู่บนเว็บไซต์ทางการของ Tongyiqianqian และ Tongyi APP ผู้ใช้ยังสามารถเรียกใช้ API ของ Qwen-Max ผ่าน AliCloud Hundred Refinement Platform ได้อีกด้วย

รูปภาพ

▲Qwen-Max ดำเนินการอัพเกรดอย่างครอบคลุม

นับตั้งแต่เปิดตัว Tongyi Qianqian รุ่นใหญ่รุ่นแรกในเดือนเมษายน 2023 AliCloud ช่วยให้บริษัทต่างๆ ในจีนสามารถใช้รุ่นใหญ่ได้ด้วยต้นทุนต่ำ ซึ่งส่งผลให้ซีรีส์ Qwen2.5 ในปัจจุบัน "มีประโยชน์มากขึ้นเรื่อยๆ"

โมเดลซีรีส์ Qwen2.5 ครอบคลุมถึงเวอร์ชันพื้นฐาน เวอร์ชันการทำตามคำสั่ง เวอร์ชันเชิงปริมาณ ซึ่งจะมีการวนซ้ำในสถานการณ์โลกแห่งความเป็นจริง

03.ยอดดาวน์โหลด Qwen ทะลุ 40 ล้านครั้ง! มี "เด็กทารก" เกิดมาแล้วมากกว่า 50,000 คน

หลังจากพัฒนาอย่างรวดเร็วมาหนึ่งปีครึ่ง Tongyi Qwen ก็ได้กลายเป็นกลุ่มนางแบบระดับโลกเป็นรองเพียง Llama เท่านั้น

โจว จิงเหริน ประกาศชุดข้อมูลล่าสุดสองชุดเพื่อยืนยันเรื่องนี้:

ประการแรก จำนวนการดาวน์โหลดโมเดล ณ ต้นเดือนกันยายน 2024 ยอดดาวน์โหลดสะสมของโมเดลโอเพนซอร์สของ Tongyi Qianwen สูงเกิน 40 ล้านครั้ง ซึ่งเป็นผลมาจากนักพัฒนาและ SME ที่มาโหวต

ประการที่สองคือจำนวนของโมเดลที่ได้มา โดยเมื่อต้นเดือนกันยายน จำนวนโมเดลดั้งเดิมและที่ได้มาทั้งหมดของ Tongyi เกิน 50,000 โมเดล เป็นรองเพียง Llama เท่านั้น

▲ยอดดาวน์โหลดสะสมโมเดลโอเพ่นซอร์ส Tongyi Thousand Questions เกิน 40 ล้านครั้ง

จนถึงขณะนี้ “10,000 โมเดลจากแหล่งที่มาเดียวกัน” ได้กลายเป็นแนวโน้มสำคัญในการพัฒนาอุตสาหกรรมโมเดลขนาดใหญ่ของจีน

แนวคิดคืออะไร? โอเพ่นซอร์สของจีนไม่เพียงแต่ติดอันดับหนึ่งของโลกในด้านประสิทธิภาพเท่านั้น แต่ยังรวมถึงในด้านการขยายตัวทางนิเวศวิทยาด้วย ชุมชนโอเพ่นซอร์ส พันธมิตรทางนิเวศวิทยา และนักพัฒนาทั้งในและต่างประเทศได้กลายมาเป็น “น้ำประปา” ของ Tongyi Chienqin ซึ่งได้กลายมาเป็นโมเดลใหญ่ตัวแรกที่องค์กรต่างๆ นำมาใช้ และยังเป็นโมเดลใหญ่ที่ใช้มายาวนานที่สุดอีกด้วย

ในเดือนสิงหาคม 2023 Aliyun ได้เปิดซอร์สโมเดลพารามิเตอร์ 7 พันล้านของ Tongyi Qwen เพื่อเผยแพร่สู่ตลาดฟรี จากนั้น Qwen1.5, Qwen2, Qwen2.5 ของปีนี้ก็เปิดตัวทีละตัว เพื่อให้นักพัฒนาสามารถใช้โมเดลขั้นสูงที่สุดได้อย่างรวดเร็วในเวลาเดียวกัน เพื่อให้ได้พื้นที่ควบคุมและปรับแต่งที่มากขึ้น จึงกลายเป็นตัวเลือกที่ต้องการขององค์กรต่างๆ มากขึ้น

เมื่อต้นเดือนกรกฎาคม วิศวกรจาก Hugging Face ซึ่งเป็นชุมชนโอเพ่นซอร์สที่ใหญ่ที่สุดในโลก ได้ทวีตข้อความเพื่อรับรองว่า Tongyi เป็นโมเดลใหญ่ที่รวบรวมผู้คนมากที่สุดในประเทศจีน และผ่านทาง AliCloud ทำให้ Tongyi Big Model ให้บริการลูกค้ามากกว่า 300,000 รายในอุตสาหกรรมต่างๆ ในไตรมาสที่สองที่ผ่านมาของปี 2024 (ซึ่งตรงกับไตรมาสที่ 1 ของปีงบประมาณ 2025 ของ Alibaba) รายได้จากผลิตภัณฑ์ที่เกี่ยวข้องกับ AI ของ Aliyun เติบโตขึ้นถึงสามหลัก

▲Tongyi Big Model ให้บริการลูกค้ามากกว่า 300,000 ราย

อาลีหยุนทำสิ่งใดถูกต้อง?

ในความเห็นของฉัน ไม่เหมือนกับผู้ผลิตขนาดใหญ่ต่างชาติอย่าง Microsoft และ ChatGPT ที่มีการผูกมัดอย่างแข็งแกร่ง และการบรรจบกันของ Amazon AWS ของโมเดลสามฝ่ายในการทำโครงสร้างพื้นฐานพื้นฐาน Aliyun ได้บูรณาการข้อดีของทั้งสองอย่างตั้งแต่เริ่มต้น เลือกใช้บริการโครงสร้างพื้นฐาน AI และทำการวิจัยโมเดลขนาดใหญ่ด้วยตนเองทั้งสองมือ

Ali Cloud ซึ่งเน้นที่โมเดลการวิจัยด้วยตนเอง เป็นยักษ์ใหญ่ด้านคลาวด์เพียงรายเดียวในจีนที่มีความชัดเจนอย่างมั่นคงในเรื่องโอเพนซอร์สและความเปิดกว้างของโมเดล และได้ทุ่มเทอย่างเต็มที่ในการลงทุนครั้งใหญ่ในด้านการพัฒนาโมเดล ความเข้ากันได้ทางนิเวศน์ บริการนักพัฒนา ฯลฯ เพื่อให้โมเดลใหญ่ของ Tongyi ก้าวขึ้นสู่แกนหลักของการแข่งขัน AI ของโลกทีละขั้นตอน

04. บทสรุป: แบบจำลองทั้งหมดมีจุดกำเนิดเดียวกัน จุดเปลี่ยนสำคัญของอุตสาหกรรม

โมเดลโอเพ่นซอร์สกำลังตามทันหรืออาจถึงขั้นตามทันโมเดลโอเพ่นซอร์สปิด ตั้งแต่ Llama-405B ของ Meta ในเดือนกรกฎาคม ไปจนถึง Qwen2.5-72B ของ AliCloud ในปัจจุบัน ภาพรวมของ "โมเดลทั้งหมดจากแหล่งเดียวกัน" กำลังเริ่มเป็นรูปเป็นร่างขึ้น การเพิ่มขึ้นอย่างรวดเร็วของโมเดลขนาดใหญ่ Tongyi Qianqi ในระยะเวลาหนึ่งปีครึ่งทำให้หลายอุตสาหกรรมและองค์กรสามารถบรรลุการลงจอดในระดับ AI ที่มีต้นทุนต่ำลง และอุตสาหกรรมกำลังเข้าสู่ช่วงเวลาสำคัญครั้งใหม่

คำถามที่พบบ่อย

- ถาม: มีขนาดรุ่นต่างๆ อะไรบ้างสำหรับ Qwen2.5? A: Qwen2.5 นำเสนอโมเดลต่างๆ ตั้งแต่พารามิเตอร์ 0.5B ถึง 72B ซึ่งให้ตัวเลือกสำหรับการใช้งานและความต้องการที่หลากหลาย

- ถาม: Qwen2.5 รองรับงานการเขียนโปรแกรมอย่างไร A: Qwen2.5 ประกอบด้วยซีรีย์เฉพาะที่เรียกว่า Qwen2.5-Coder ซึ่งได้รับการออกแบบมาเพื่อปรับปรุงการสร้างโค้ด การอนุมาน และการดีบัก พร้อมรองรับโทเค็นสูงสุด 128,000 โทเค็น

- ถาม: ข้อมูลการฝึกอบรมสำหรับ Qwen2.5 เป็นอย่างไร? A: Qwen2.5 ได้รับการฝึกอบรมไว้ล่วงหน้าบนชุดข้อมูลขนาดใหญ่ที่ครอบคลุมถึง 18 ล้านล้านโทเค็น ซึ่งช่วยให้เข้าใจภาษาได้อย่างกว้างขวาง

- ถาม: Qwen2.5 เหมาะสำหรับการใช้ในการศึกษาหรือไม่? ตอบ: ใช่ ความสามารถของ Qwen2.5 ในการประมวลผลภาษาธรรมชาติทำให้เหมาะกับเครื่องมือทางการศึกษา รวมถึงแพลตฟอร์มการเรียนรู้แบบโต้ตอบ

- ถาม: Qwen2.5 มีประสิทธิภาพในการวัดประสิทธิภาพเมื่อเทียบกับรุ่นอื่นอย่างไร? A: ปัจจุบัน Qwen2.5 อยู่ในอันดับที่ 3 ในเกณฑ์มาตรฐานมัลติโหมด โดยทำผลงานได้ดีกว่าโมเดลอย่าง Llama3.1 ในหลายด้าน

- ถาม: Qwen2.5 รองรับภาษาอะไรบ้าง? A: Qwen2.5 รองรับหลายภาษา รวมถึงแต่ไม่จำกัดเพียง Python, Java และ C++

- ถาม: Qwen2.5 สามารถสร้างโค้ดในภาษาการเขียนโปรแกรมหลายภาษาได้หรือไม่? ตอบ: ใช่ Qwen2.5-Coder สามารถสร้างโค้ดในภาษาการเขียนโปรแกรมต่างๆ เพื่อตอบสนองความต้องการของนักพัฒนาที่แตกต่างกัน

- ถาม: Qwen2.5 จัดการกับบริบทยาวๆ ได้อย่างไร? A: Qwen2.5 รองรับความยาวบริบทสูงสุดถึง 32K ซึ่งเป็นประโยชน์ในการปรับปรุงความแม่นยำของการเติมโค้ดและการอนุมาน

- ถาม: Qwen2.5 เป็นโอเพ่นซอร์สหรือเปล่า? A: แม้ว่าเวอร์ชั่นโอเพ่นซอร์สของ Qwen2.5 จะยังไม่ได้เปิดตัว แต่ก็มีเอกสารรายละเอียดและตัวอย่างต่างๆ บนแพลตฟอร์มต่างๆ เช่น GitHub

- ถาม: สถานการณ์การใช้งานจริงของ Qwen2.5 มีอะไรบ้าง? A: Qwen2.5 สามารถนำไปใช้ในแชทบอทฝ่ายบริการลูกค้า การสร้างเนื้อหา ความช่วยเหลือด้านการเขียนโปรแกรม การศึกษา บริการแปล ความช่วยเหลือทางกฎหมาย การสนับสนุนด้านการดูแลสุขภาพ การตลาด การวิเคราะห์ข้อมูล การรายงานอัตโนมัติ การพัฒนาเกม ผู้ช่วยเสมือน อีคอมเมิร์ซ และการสนับสนุนหลายภาษาในอุตสาหกรรมต่างๆ