Pengeditan Video Potret Didukung oleh

Prioritas Generatif Multimodal

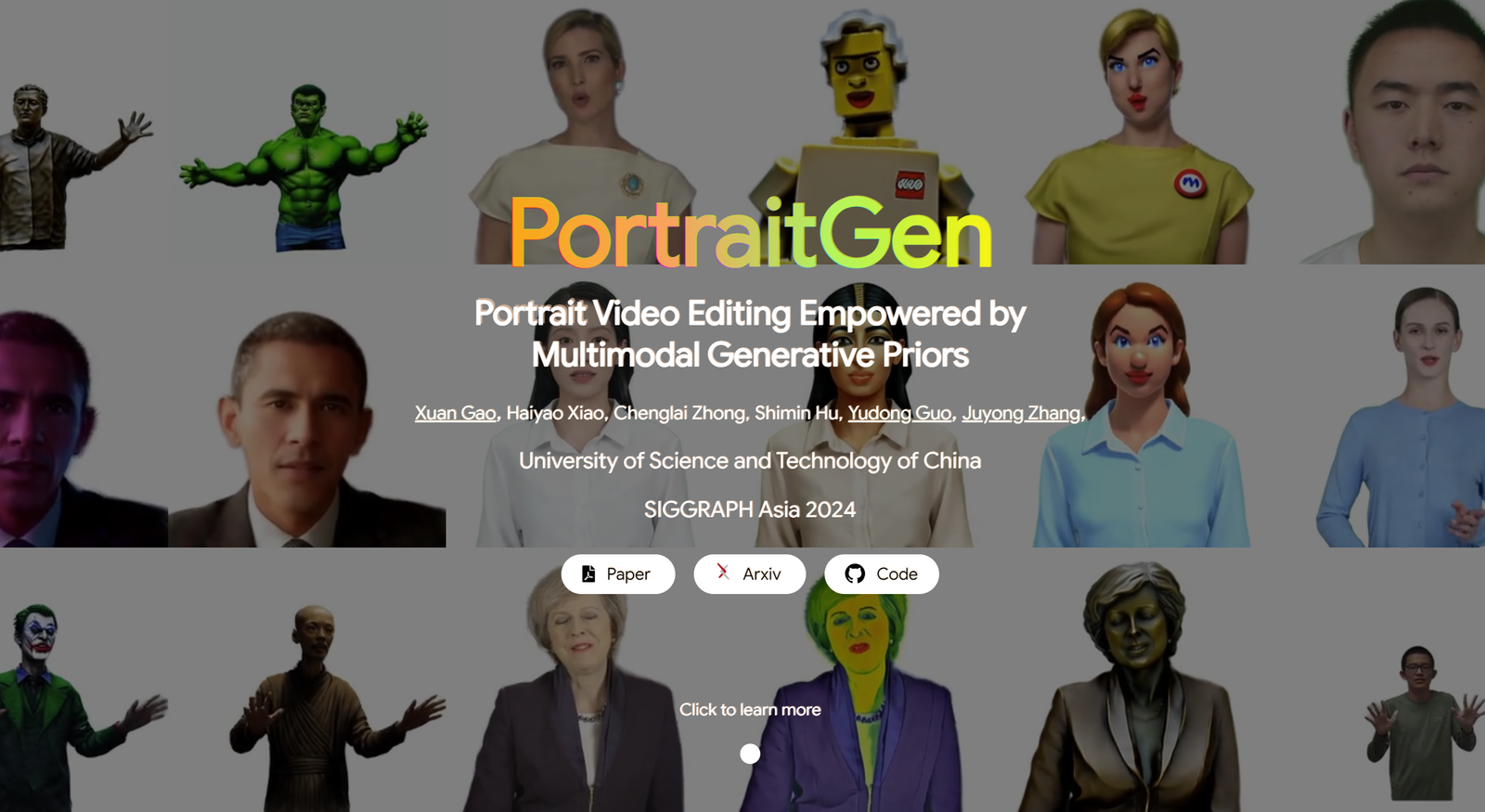

Metode penyuntingan video potret tradisional sering mengalami masalah dengan efek 3D dan konsistensi temporal, dan juga berkinerja buruk dalam hal kualitas dan efisiensi rendering. Untuk mengatasi masalah ini, PortraitGen meningkatkan setiap bingkai video potret menjadi bidang Gaussian 3D dinamis terpadu, yang memastikan konsistensi struktural dan temporal dari bingkai ke bingkai PortraitGen adalah metode pengeditan video potret yang ampuh yang memungkinkan penataan yang konsisten dan ekspresif dengan isyarat multi-moda.

Selain itu, PortraitGen telah merancang mekanisme tekstur neural Gaussian baru yang tidak hanya memungkinkan penyuntingan gaya yang rumit, tetapi juga memungkinkan kecepatan rendering lebih dari 100 frame per detik, PortraitGen memadukan berbagai macam input yang disempurnakan oleh pengetahuan yang disaring dari model generatif 2D berskala besar. Ini juga memperkenalkan panduan kemiripan ekspresi dan modul penyuntingan potret pengenalan wajah, yang secara efektif mengurangi masalah yang bisa terjadi ketika memperbarui dataset secara berulang-ulang. (Tautan di bagian bawah artikel)

01 Isi Keterangan

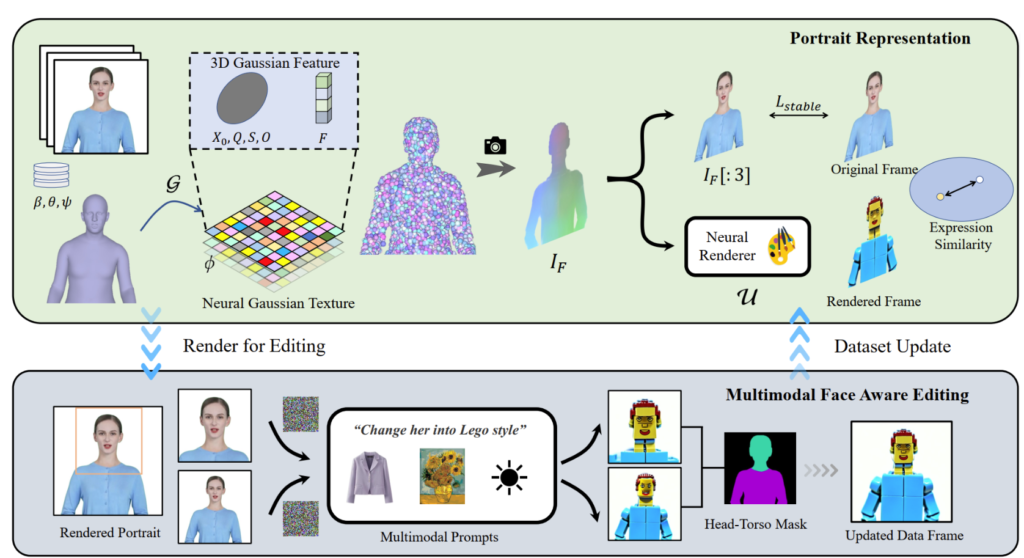

PortraitGen mengangkat video potret 2D ke dalam bidang Gaussian 4D untuk pengeditan potret multimodal hanya dalam waktu 30 menit. Potret 3D yang diedit dapat dirender pada 100 frame per detik. Koefisien SMPL-X dalam video bermata pertama kali dilacak, dan kemudian bidang fitur Gaussian 3D dihasilkan dengan menggunakan mekanisme tekstur Neuro-Gaussian.

Data Neuro-Gaussian ini diproses lebih lanjut untuk merender gambar potret, PortraitGen juga menggunakan strategi pembaruan kumpulan data berulang untuk pengeditan potret dan mengusulkan modul pengeditan pengenalan wajah untuk meningkatkan kualitas ekspresi dan melestarikan struktur wajah yang dipersonalisasi.

02 Penggunaan Praktis

Solusi PortraitGen adalah kerangka kerja terpadu untuk penyuntingan video potret. Model pengeditan gambar apa pun yang mempertahankan struktur dapat digunakan untuk menyusun video potret 3D yang konsisten dan koheren secara temporal.

Pengeditan berbasis teks: InstructPix2Pix digunakan sebagai model penyuntingan 2D. UNet-nya membutuhkan tiga masukan: gambar RGB masukan, perintah teks, dan noise laten. Menambahkan beberapa noise pada gambar yang dirender dan mengeditnya berdasarkan gambar sumber input dan instruksi.

Penyuntingan berbasis gambar: berfokus pada dua jenis penyuntingan berdasarkan petunjuk gambar. Salah satunya adalah mengekstrak gaya global dari gambar referensi dan yang lainnya adalah menyesuaikan gambar dengan menempatkan objek di lokasi tertentu. Metode ini digunakan secara eksperimental untuk migrasi gaya dan penyesuaian virtual. Gaya gambar referensi dimigrasikan ke frame dataset menggunakan algoritma Neural Style Migration dan pakaian subjek diubah menggunakan AnyDoor.

Relighting: menggunakan IC-Light untuk memanipulasi pencahayaan bingkai video. Dengan memberikan deskripsi teks sebagai kondisi pencahayaan, metode PortraitGen secara harmonis menyesuaikan pencahayaan video potret wajah

03 Eksperimen Kontras dan Ablasi

Metode PortraitGen dibandingkan dengan metode pengeditan video yang canggih termasuk TokenFlow, Rerender A Video, CoDeF, dan AnyV2V. metode PortraitGen secara signifikan mengungguli metode lainnya dalam hal pelestarian tepat waktu, pelestarian identitas, dan konsistensi temporal.

Durasi waktu 00:47

Terinspirasi oleh tekstur saraf yang diusulkan dalam 'Delayed Neural Rendering', PortraitGen mengusulkan tekstur saraf Gaussian. Pendekatan ini menyimpan fitur yang dapat dipelajari untuk setiap Gaussian alih-alih menyimpan koefisien harmonik bola. Selanjutnya, perender neural 2D digunakan untuk mengubah peta fitur yang diproses menjadi sinyal RGB. Metode ini memberikan informasi yang lebih kaya daripada koefisien harmonik sferis dan memungkinkan penggabungan yang lebih baik dari fitur yang diproses, sehingga lebih mudah untuk mengedit gaya yang kompleks seperti Lego dan pixel art.

Apabila menyunting gambar tubuh bagian atas, jika wajah menempati area yang kecil, penyuntingan model mungkin tidak dapat disesuaikan dengan baik ke pose kepala dan struktur wajah. Pengeditan Potret Kesadaran Wajah (FA) dapat menyempurnakan hasilnya dengan melakukan dua pengeditan untuk meningkatkan fokus pada struktur wajah.

Dengan memetakan gambar yang dirender dan gambar sumber input ke dalam ruang ekspresi laten EMOCA dan mengoptimalkan kemiripan ekspresi, kami dapat memastikan bahwa ekspresi tetap alami dan konsisten dengan frame video asli.

Teknologi di balik PortraitGen

Refrensi

Anda dapat menemukan informasi lebih lanjut tentang PotraitGen di sini: https://ustc3dv.github.io/PortraitGen/