同義千闊のダウンロード数は4000万を超え、5万人以上の子供モデルが「誕生」した。

くだらない話はさておき、まずはQwenをここでテストしてみましょう:

クラウドコンピューティング「春節祭」雲奇大会が開幕、同義奇文のビッグモデルが再び舞台を席巻!

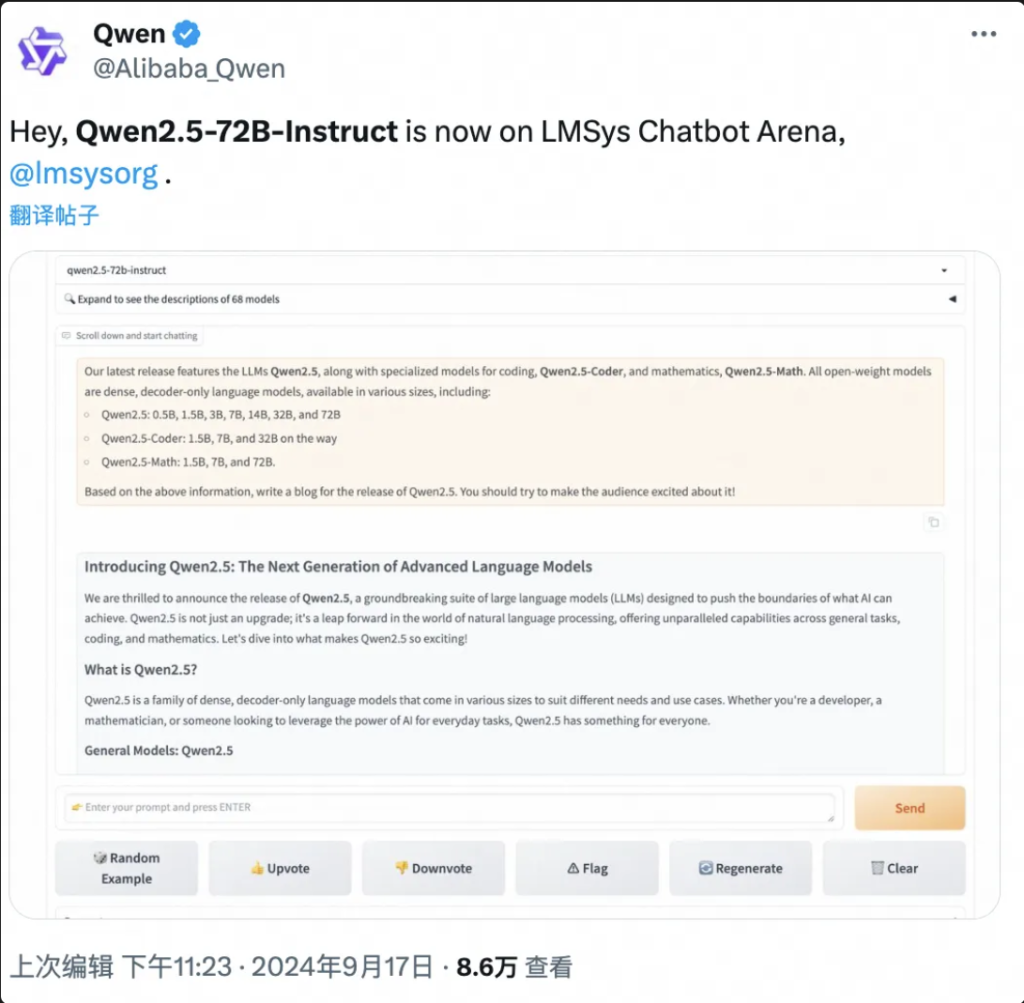

智慧は9月19日、杭州で本日、アリクラウドが世界最強のオープンソース大型モデルQwen2.5-72Bをリリースしたと報道した。その性能は「クロスメジャー」でLlama3.1-405Bを超え、グローバルオープンソース大型モデルの座に就いた。

以下はこのプロジェクトの作業結果の要約です。

Qwen2.5-72B は、多くの権威あるテストで Llama-405B よりも優れた性能を発揮します。

同時に、言語モデルQwen2.5、視覚言語モデルQwen2-VL-72B、プログラミングモデルQwen2.5-Coder、数学モデルQwen2.5-Mathなど、一連のQwen2.5モデルがオープンソース化され、累計100個以上が店頭に並び、そのうちのいくつかはGPT-4oの性能に追いつき、世界新記録を樹立しました。

「クレイジーな木曜日」、「エピックプロダクト」……リリースから数時間で、Qwen2.5は国内外のソーシャルメディアで熱狂的な議論を巻き起こし、世界中の開発者が試用テストチームに参加しました。

▲Qwen2.5は国内外のSNSで話題となっている。

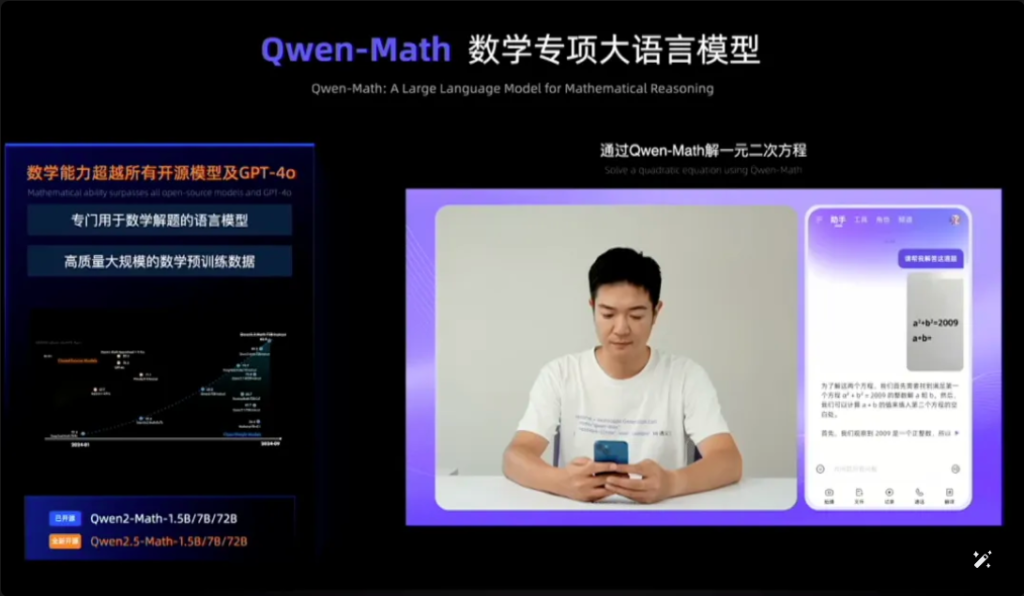

例えば、Qwen2.5-Mathは視覚認識とQwen2.5-Mathを組み合わせています。幾何学的に類似した多肢選択問題のスクリーンショットを入力すると、Qwen2.5-Mathは質問の意味を素早く認識し、正しい解決策と回答「B」を提示します。正確性とスピードの両方を兼ね備えています。その正確性とスピードは驚異的です。

Qwen2.5-Math をウェブ上で見るのは今回が初めてです。

▲Qwen2.5-数学トライアル

2023年4月からわずか1年半で、QwenはLlamaに次ぐ世界クラスのモデルグループに成長しました。

AliCloudのCTOである周景仁氏が発表した最新データによると、2024年9月中旬時点で、Tongyi Qwenのオープンソースモデルの累計ダウンロード数は4,000万を超え、5万以上の大型モデルが派生している。

▲Qwenシリーズ派生5万台超の大型モデル

Qwen 2.5 の具体的なパフォーマンス向上点は何ですか? 100 の新しいオープン ソース モデルのハイライトは何ですか? Qwen2.5 は世界初であり、中国でも初めての製品です。

ブログアドレス: https://qwenlm.github.io/blog/qwen2.5/

プロジェクトアドレス: https://huggingface.co/spaces/Qwen/Qwen2.5

▲公式ブログがAliyun Qwen 2.5モデルクラスターを公開

01.再び世界ランキングトップ、Qwen2.5クロスボリュームがLlama3.1-405Bに追いつく

Qwen2.5のパフォーマンスを具体的に見てみましょう。

Qwen2.5 モデルは最大 128K のコンテキスト長をサポートし、最大 8K のコンテンツを生成でき、29 以上の言語をサポートしているため、ユーザーが 10,000 語の記事を書くのに役立ちます。

それだけでなく、18T トークン データの事前トレーニングに基づくと、Qwen2.5 は Qwen2 と比較して全体的なパフォーマンスが 18% 以上向上し、知識が増え、プログラミングと数学のスキルが強化されています。

▲Qwen2.5について説明するAliCloud CTO Zhou Jingren

主力モデルであるQwen2.5-72Bモデルは、一般知識を問うMMLU-rudexベンチマーク、コーディング能力を問うMBPPベンチマーク、数学能力を問うMATHベンチマークでそれぞれ86.8、88.2、83.1という高得点を獲得したと報告されています。

720億のパラメータを持つQwen2.5は、4050億のパラメータを持つLlama3.1-405Bよりも「桁違いに」優れています。

Llama3.1-405Bは2024年7月にMeta社からリリースされ、150以上のベンチマークテストセットで当時のSOTA(業界最高)モデルGPT-4oと同等かそれ以上の成績を収め、「最強のオープンソースモデルが最強のモデル」という主張を引き起こしました。

Qwen2.5 の後継バージョンである Qwen2.5-72B-Instruct は、MMLU-redux、MATH、MBPP、LiveCodeBench、Arena-Hard、AlignBench、MT-Bench、MultiPL-E、およびその他の権威ある評価において Llama3.1-405B を上回りました。405B。

写真

▲Qwen2.5-72Bモデル評価状況

Qwen2.5 は再び世界最強のオープンソース モデルとなり、「クローズド ソースよりもオープンソース」という業界のトレンドに貢献しています。

これは、AliCloudが今年6月にオープンソースのTongyi Qianqian Qwen2シリーズに続き、当時最強のオープンソースモデルLlama3-70Bに追いつき、その後一連のオープンソースバージョンをリリースしたことです。

AI 開発者コミュニティでは、新しい王が登場するたびに、すぐに新しいバージョンの Tongyi に追い抜かれるのがおなじみのパターンになっています。

9月18日の夜にQwen2.5が公開された後、多くの開発者が興奮して眠れず、真っ先に試してみました。

それができるかどうか分かりません。

▲国内外の開発者がQwen2.5を熱く議論

02.世界史上最大のモデリングコミュニティ

最も重要なことは、世界で何が起こっているのか、そしてそれがどのように機能しているのかをよく理解することです。

Qwen2.5 オープン ソース モデリング コミュニティはこれまでで最大規模です。

AliCloudのCTOである周景仁氏は、雲奇カンファレンスで、Qwen2.5シリーズには合計100以上のオープンソースモデルがあり、さまざまなシナリオの開発者や中小企業のニーズに完全に適応していると発表した。

これは、主要ソーシャルメディアで長らく「促してきた」多くの開発者の呼びかけに応えるものだ。

▲国内外の開発者がQwen2.5のさらなる普及を訴える

1、言語モデル:0.5Bから72Bまでの7つのサイズ、エンドサイドから産業グレードのシナリオまで完全にカバー

Qwen2.5 は、0.5B、1.5B、3B、7B、14B、32B、72B の 7 つのサイズの言語モデルをオープンソース化しており、これらはすべて対応するトラックで SOTA 結果を達成しています。

写真

▲マルチサイズのQwen2.5は多様なシーンのニーズを満たします

自然言語処理 (NLP) とコーディング理解の高度な機能を備えた Alibaba Cloud の Qwen2.5 は、幅広いアプリケーションに対応できるように設計されています。Qwen2.5 を活用できる具体的なシナリオは次のとおりです。

- 強化されたカスタマーサービス: Qwen2.5 は、チャットボットで採用することで、より人間らしいやり取りが可能になり、顧客の質問に効果的に回答し、ソリューションを提供できます。

- コンテンツ作成: このモデルは、記事、ソーシャル メディアの投稿、その他の書面によるコンテンツの生成を支援し、コンテンツ作成者の時間を節約します。

- プログラミング支援: 特化された Qwen2.5-Coder シリーズにより、コード スニペットの提案、デバッグのヘルプ、特定のコーディング タスクの自動化などを通じて開発者を支援できます。

- 教育と学習: Qwen2.5 は、説明を提供したり、生徒の質問に答えたり、課題を採点したりするインタラクティブな学習プラットフォームなどの教育ツールの開発に使用できます。

- 翻訳サービス: 複数の言語に精通しているため、国際コミュニケーションにおける言語のギャップを埋めるリアルタイム翻訳サービスを提供できます。

- 研究開発: 研究では、Qwen2.5 は大量のテキスト データを処理して、パターンの発見、調査結果の要約、レポートの生成を支援します。

- 法的支援: このモデルは、法務文書を読み取り、関連情報を抽出し、基本的な法務文書を起草することもできるため、法務専門家の時間を節約できます。

- ヘルスケアサポート: Qwen2.5 は、一般的な健康に関する質問に答えたり、医療情報を提供したり、患者データの管理を支援したりするために使用できます。

- マーケティングと広告: 特定のユーザー層をターゲットにしたパーソナライズされたマーケティング コンテンツ、広告コピー、ソーシャル メディア キャンペーンの作成に役立ちます。

- データ分析: Qwen2.5 は、大規模なデータセットを処理および分析して洞察を提供し、データに基づいた意思決定を支援します。

- 自動レポート: このモデルは、さまざまな分野のデータと情報を処理してレポートを生成できるため、財務分析やビジネス分析に特に役立ちます。

- ゲーム開発: Qwen2.5 は、ビデオ ゲーム キャラクターのインタラクティブなダイアログや物語を作成して、プレイヤーのエンゲージメントを高めるのに役立ちます。

- 仮想アシスタント: スケジュールの管理、リマインダーの設定、パーソナライズされたアドバイスの提供などができる仮想アシスタントを駆動します。

- 電子商取引: Qwen2.5 は、製品の説明の生成、顧客からの問い合わせの処理、パーソナライズされたショッピング体験の作成に役立ちます。

- 多言語サポート: 国際的な顧客サービスやコンテンツのローカリゼーションなど、多言語でのやり取りを必要とするグローバル アプリケーションで使用できます。

これらのバージョンは、開発者がモデルの機能とコストのバランスを取り、さまざまなシナリオに適応するのに役立ちます。たとえば、3B は携帯電話やその他のエンドサイドデバイスに適応するための黄金サイズであり、32B は開発者が「コスト効率の王様」として最も期待しているサイズであり、72B は産業グレードおよび科学研究グレードのシナリオのパフォーマンスの王様です。

ブログアドレス: https://qwenlm.github.io/zh/blog/qwen2.5-llm/

2、マルチモーダルモデル:視覚モデルは20分間のビデオを理解し、音声言語モデルは8つの言語をサポートします。

待望の大規模ビジュアル言語モデルである Qwen2-VL-72B が、本日正式にオープンソース化されました。

Qwen2-VL は、さまざまな解像度やアスペクト比の画像を認識し、20 分を超える長いビデオを理解し、携帯電話やデバイスの視覚インテリジェンスを調整する機能を備え、視覚理解の GPT-4o レベルを超えています。

▲大規模視覚言語モデルQwen2-VL-72Bオープンソース

Qwen2-VL-72B は、世界的に権威のある評価である LMSYS Chatbot Arena Leaderboard で最高得点を獲得したオープンソースの視覚理解モデルとなりました。

Qwen2-VL-72B は、最高得点を獲得したオープンソースの視覚理解モデルです。

Qwen2-Audio大規模音声言語モデルは、人間の声、音楽、自然音を理解し、音声チャット、音声メッセージ分析をサポートし、8つ以上の言語と方言をサポートできるオープンソースモデルであり、主流の評価指標で世界をリードしています。

ブログアドレス: http://qwenlm.github.io/blog/qwen2-vl/

3、特殊モデル:最も先進的なオープンソース数学モデルがデビューし、GPT-4oに追いつく

プログラミング用の Qwen2.5-Coder と数学用の Qwen2.5-Math も、この Cloud Habitat カンファレンスでオープンソースとして発表されました。

その中でも、Qwen2.5-Mathはこれまでで最も先進的なオープンソース数学モデルシリーズであり、今回はオープンソースの1.5B、7B、72Bの3つのサイズと数学報酬モデルQwen2.5-Math-RMです。

▲Qwen2.5-Mathオープンソース

フラッグシップモデルの Qwen2-Math-72B-Instruct は、数学関連のダウンストリームタスクにおいて、GPT-4o や Claude 3.5 などの独自モデルよりも優れたパフォーマンスを発揮します。

最大5.5Tトークンのプログラミング関連データでトレーニングされたQwen2.5-Coderは、バージョン1.5Bと7Bが同日にオープンソース化され、今後バージョン32Bでもオープンソース化される予定です。

▲Qwen2.5-Coderオープンソース

ブログアドレス:

https://qwenlm.github.io/zh/blog/qwen2.5-math/

https://qwenlm.github.io/zh/blog/qwen2.5-coder/

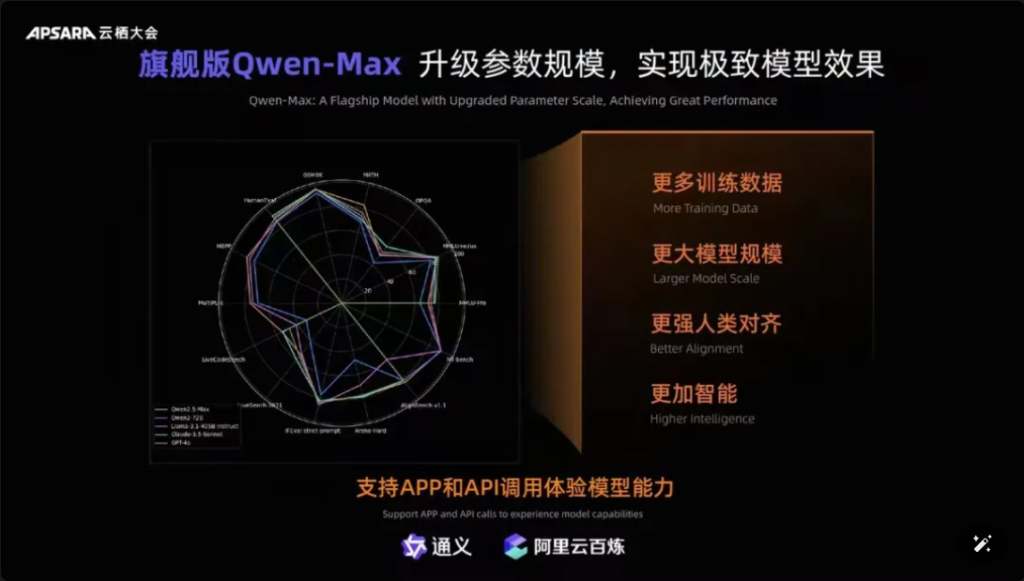

さらに、特筆すべきは、TongyiqianqianのフラッグシップモデルであるQwen-Maxが全面的にアップグレードされ、MMLU-Pro、MATHなど10を超える権威あるベンチマークでGPT-4oに迫り、さらには上回り、Tongyiqianqianの公式サイトとTongyi APPでオンラインになっていることです。ユーザーは、AliCloud百精錬プラットフォームを通じてQwen-MaxのAPIを呼び出すこともできます。

写真

▲Qwen-Maxが全面的なアップグレードを実現

AliCloudは、2023年4月に第1世代のTongyi Qianqian大型モデルをリリースして以来、中国企業が大型モデルを低コストで使用できるようにし、今日のQwen2.5シリーズを「ますます便利」にしてきました。

Qwen2.5 シリーズのモデルには、基本バージョン、コマンド従属バージョン、定量バージョンがあり、実際のシナリオで反復されます。

03.Qwenダウンロード数4000万突破!誕生した「赤ちゃん」は5万体以上。

1年半の急速な発展を経て、Tongyi QwenはLlamaに次ぐ世界クラスのモデルグループとなった。

周景仁氏はこれを裏付ける最新のデータ2つを発表した。

まず、モデルのダウンロード数ですが、2024年9月初旬現在、Tongyi Qianwenのオープンソースモデルの累計ダウンロード数は4,000万を超えており、これは開発者と中小企業の支持の結果です。

2つ目は派生モデルの数です。9月初旬の時点で、Tongyiのネイティブモデルと派生モデルの合計数は5万を超え、Llamaに次ぐ数です。

▲同義千問オープンソースモデルの累計ダウンロード数が4000万を突破

現在までに、「1万種類のモデルが同じ出所」は中国の大型模型産業の発展における重要なトレンドとなっている。

そのコンセプトとは?中国のオープンソースは、パフォーマンスの面だけでなく、エコシステムの拡大の面でも世界一です。国内外のオープンソースコミュニティ、エコシステムパートナー、開発者は、同義建琴の「水道水」となり、多くの企業が最初に採用したビッグモデルとなり、最も長く使用されているビッグモデルにもなりました。

Aliyunは早くも2023年8月にTongyi Qwenの70億パラメータモデルをオープンソース化し、無料で商用化しました。その後、今年はQwen1.5、Qwen2、Qwen2.5が次々とリリースされ、開発者は最も先進的なモデルを同時に迅速に使用できるようになり、より広い制御とチューニング空間を獲得し、より多くの企業の優先的な選択肢となりました。

7月初旬、世界最大のオープンソースコミュニティであるHugging Faceのエンジニアは、Tongyiが中国で最も普及しているビッグモデルであるとツイートして認定しました。そして、TongyiビッグモデルはAliCloudを通じて、さまざまな業界の30万人以上の顧客にサービスを提供しています。ちょうど過ぎた2024年第2四半期(アリババの2025年度第1四半期に相当)には、AliyunのAI関連製品の売上高は3桁の成長を実現しました。

▲同義ビッグモデルは30万人以上の顧客にサービスを提供

Aliyun は何をうまくやったのでしょうか?

私の意見では、MicrosoftとChatGPTの強い結びつきや、AmazonとAWSの3者モデルが融合して基盤インフラを構築する海外の大手メーカーとは異なり、Aliyunは両者の利点を統合し、最初からAIインフラサービスと自社研究の大手モデルを両手で選択しました。

Ali Cloud は、自社研究モデルに注力し、モデルのオープンソース化と開放性を明確に認識している中国唯一のクラウド大手であり、モデルのブレークスルー、エコシステムの互換性、開発者サービスなどに多大な投資を惜しまず、Tongyi のビッグモデルを世界の AI 競争の中核サークルに一歩ずつ組み入れています。

04.結論: すべてのモデルの起源は同じである 業界の転換点

オープンソースモデルはクローズドソースモデルに追いつき、あるいは追い越しつつあります。7月のMetaのLlama-405Bから今日のAliCloudのQwen2.5-72Bまで、「すべてのモデルは同じソースから」という風景が形成されつつあります。Tongyi Qianqi大型モデルの1年半の急増により、多くの業界と企業が低コストのAIスケールの着陸を実現し、業界は新たな分水嶺の瞬間を迎えています。

よくある質問

- Q: Qwen2.5 にはどのようなモデル サイズがありますか? A: Qwen2.5 は、0.5B から 72B のパラメータのモデルを幅広く提供しており、さまざまなアプリケーションや要件に対応するオプションを提供します。

- Q: Qwen2.5 はプログラミング タスクをどのようにサポートしますか? A: Qwen2.5 には、最大 128K トークンをサポートし、コード生成、推論、デバッグを強化するように設計された Qwen2.5-Coder と呼ばれる特殊なシリーズが含まれています。

- Q: Qwen2.5 のトレーニング データはどのようなものですか? A: Qwen2.5 は、最大 18 兆のトークンをカバーする膨大なデータセットで事前トレーニングされており、言語の幅広い理解を保証します。

- Q: Qwen2.5 は教育での使用に適していますか? A: はい、Qwen2.5 の自然言語処理機能は、インタラクティブ学習プラットフォームなどの教育ツールに適しています。

- Q: Qwen2.5 は他のモデルと比較してベンチマークでどのように機能しますか? A: Qwen2.5 は現在、マルチモーダル ベンチマークで 3 位にランクされており、いくつかの領域で Llama3.1 などのモデルを上回っています。

- Q: Qwen2.5 はどの言語をサポートしていますか? A: Qwen2.5 は、Python、Java、C++ などを含む複数の言語をサポートしています。

- Q: Qwen2.5 は複数のプログラミング言語でコードを生成できますか? A: はい、Qwen2.5-Coder はさまざまなプログラミング言語でコードを生成でき、さまざまな開発者のニーズに応えます。

- Q: Qwen2.5 は長いコンテキストをどのように処理しますか? A: Qwen2.5 は最大 32K のコンテキスト長をサポートしており、コード補完と推論の精度を向上させるのに役立ちます。

- Q: Qwen2.5 はオープンソースですか? A: Qwen2.5 のオープンソース バージョンはまだリリースされていませんが、詳細なドキュメントと例は GitHub などのプラットフォームで入手できます。

- Q: Qwen2.5 の実際のアプリケーション シナリオにはどのようなものがありますか? A: Qwen2.5 は、さまざまな業界のカスタマー サービス チャットボット、コンテンツ作成、プログラミング支援、教育、翻訳サービス、法的支援、ヘルスケア サポート、マーケティング、データ分析、自動レポート作成、ゲーム開発、仮想アシスタント、電子商取引、多言語サポートに活用できます。